Lorsque Jean-Paul Sartre publie Les Mots en 1963, il divise son œuvre en deux grandes parties : “Lire” et “Écrire”. Le texte est une autobiographie qui retrace son enfance dans les années 1910.

A cette époque, la transmission du savoir se fait principalement par les livres. Le cinéma, la radio, la télévision se développeront au cours du XXème siècle. Quant à l’internet grand public, il arrivera en France en 1994.

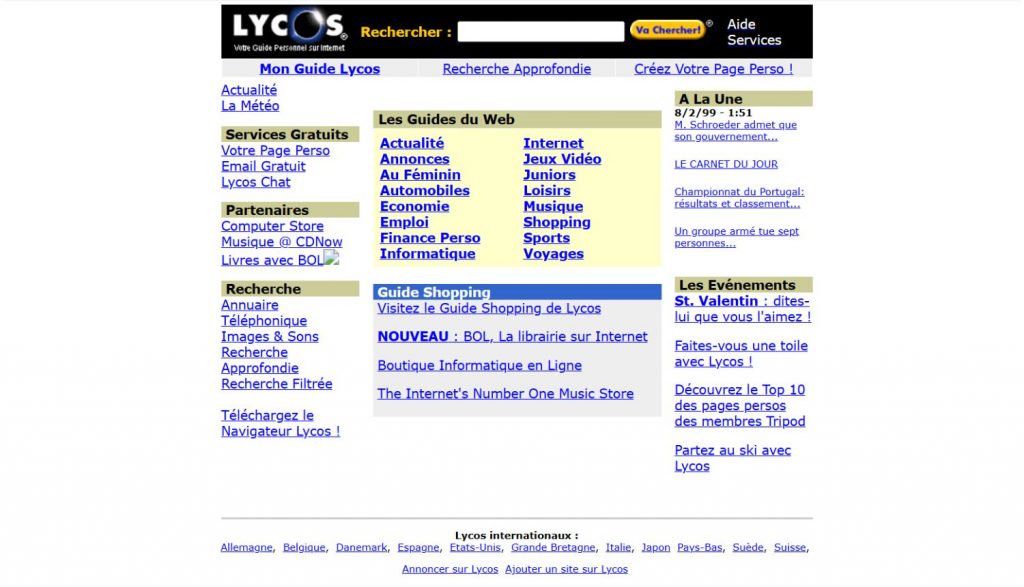

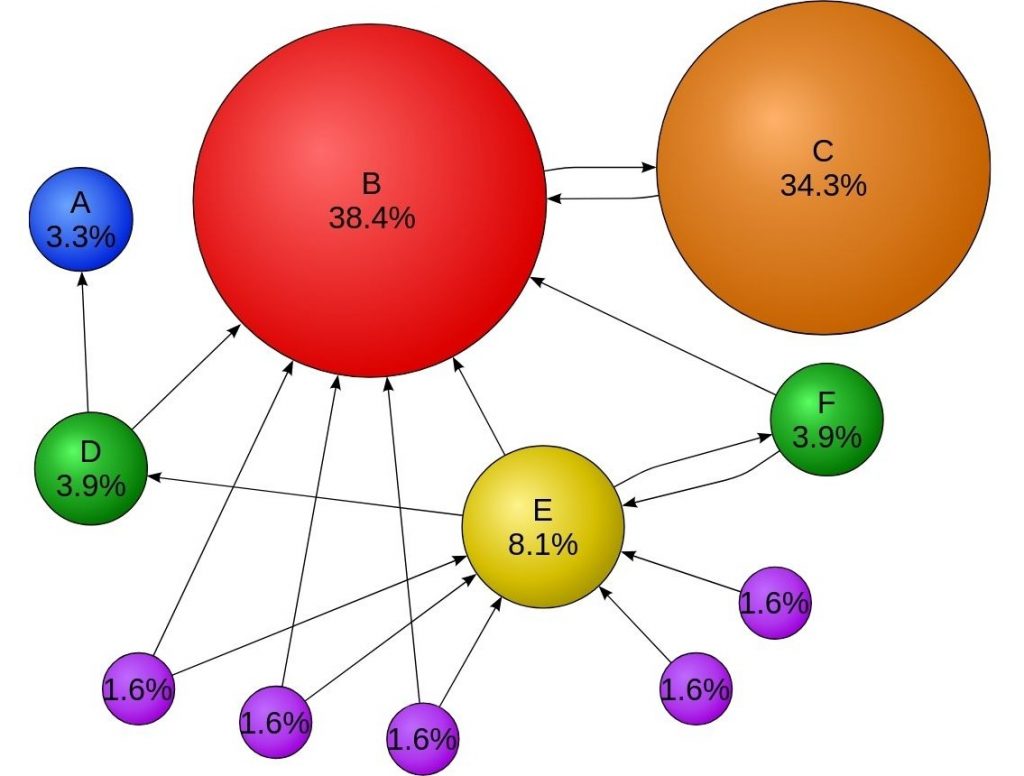

Les débuts du web, ce sont également des mots. De l’écriture et de la lecture. Les facteurs de classement des pages sur les moteurs de recherche reposent principalement sur des mots-clés et des backlinks.

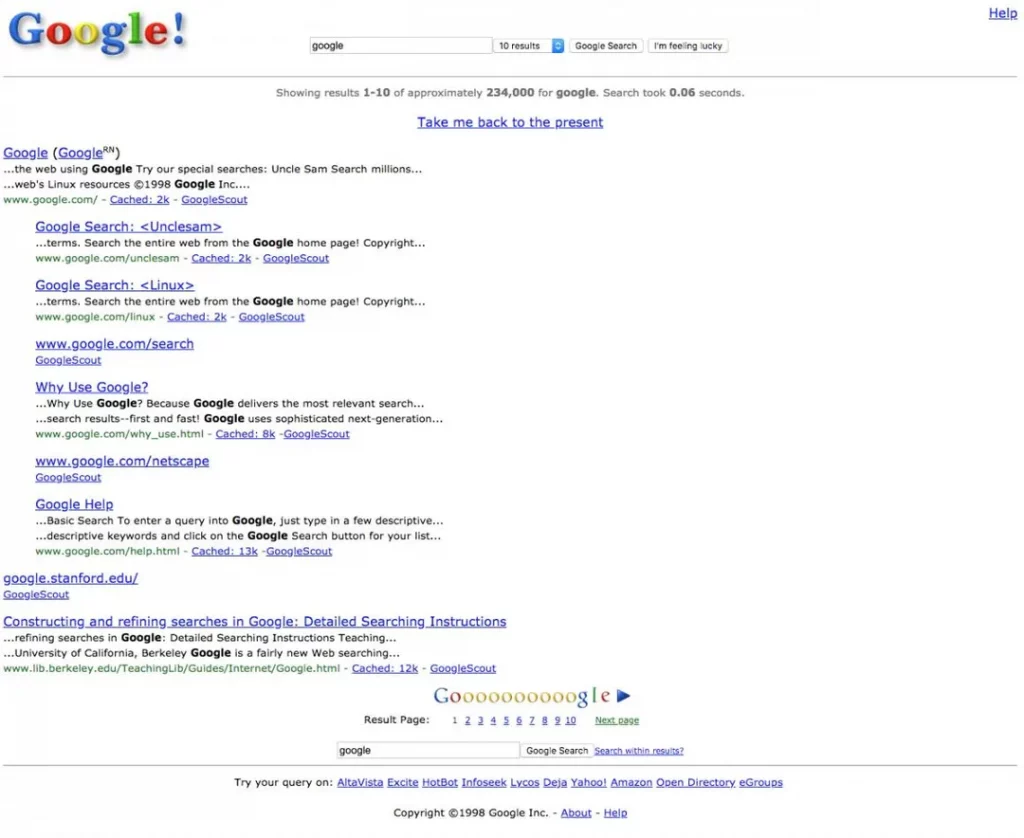

Google a bien lancé la première mise à jour majeure de son algorithme (Florida), jusqu’en 2010 beaucoup de hacks permettent encore à de mauvais contenus de ranker.

Le souci des moteurs de recherche est constant depuis leur création : offrir la meilleure expérience possible à l’utilisateur. Et cela passe par un alignement impeccable entre l’intention de recherche de l’internaute et les résultats qui lui sont proposés.

Mais au fond, c’est quoi un bon contenu ? Est-ce que les critères ont évolué ? Et une page bien positionnée sur les SERP en 2026 présente-t-elle les mêmes caractéristiques qu’en 2002 ?

2002 : un texte optimisé à tout prix

“Vous cherchez la meilleure raquette de tennis ? Découvrez la meilleure raquette pour jouer au tennis et exceller sur un court de tennis. Notre guide raquette de tennis vous aide à choisir une raquette adaptée à votre style afin d’améliorer votre performance au tennis.”

Des mots-clés et des backlinks

Au début des années 2000, le SEO repose sur une équation simple : du texte et des liens. L’UX des sites est souvent rudimentaire. Les contenus contiennent quelques images, avec une mise en page très loin des standards actuels.

Le mobile n’est pas encore un sujet. Quant à la vitesse de chargement, euh comment dire ? Beaucoup de foyers fonctionnent encore au modem 56k qui grésille, l’ADSL se développe doucement.

Google comprend surtout les mots présents dans la page et les liens qui pointent vers elle. Bien sûr, la firme de Mountain View commence déjà à lutter contre les abus. La mise à jour Florida lancée en 2003 marque l’une des premières tentatives sérieuses pour limiter le spam SEO.

Mais dans les faits, l’algorithme reste encore largement manipulable. Jusqu’au tournant des années 2010, certaines techniques basiques fonctionnent encore bien. Parmi elles, le keyword stuffing (le fameux “bourrage de mots-clés”), les pages satellites, l’usage abusif de PBN, ou encore soumissions massives dans des annuaires.

Schématiquement, une page qui répète le terme visé et reçoit beaucoup de liens a de fortes chances de remonter dans les résultats.

Aligner intention et résultat

Malgré ces pratiques, l’objectif de Google est déjà le même qu’aujourd’hui : offrir la meilleure réponse possible à l’utilisateur. Le moteur cherche donc à faire correspondre une requête avec la page la plus pertinente.

Cela repose principalement sur les mots présents dans le texte et dans les ancres de liens. Autrement dit, si un internaute tape “raquette de tennis”, la page qui répète le plus souvent cette expression et reçoit des liens avec cette ancre a de bonnes chances d’apparaître en tête des résultats.

La logique est encore très mécanique. Mais le principe fondamental est déjà là : aligner l’intention de recherche et le contenu proposé.

2014 : un bon contenu est un contenu bien structuré

Moins de hacks, plus de SEO

Google change les règles du jeu au début des années 2010. Les mises à jour Panda (2011) et Penguin (2012) marquent un tournant. La première cible les contenus de faible qualité ou dupliqués. La seconde s’attaque aux profils de backlinks artificiels.

Le SEO opère sa mue. Beaucoup de pratiques qui fonctionnaient quelques années plus tôt deviennent risquées, voire contre-productives.

Les contenus longs sont la référence pour traiter un sujet en profondeur et capter davantage de mots-clés. Google accorde plus d’importance à l’UX : expérience mobile, navigation plus claire, et prise en compte de la vitesse de chargement. Les sites qui ne répondent pas au responsive design perdent en visibilité.

L’optimisation sémantique au centre du jeu

“Content is King.”

Bill Gates prononce cette phrase devenue célèbre dès 1996. 20 ans plus tard, tout lui donne raison. Un contenu qui ranke ne se contente pas de répéter un mot-clé, il couvre un sujet dans son ensemble.

Les premiers outils spécialisés apparaissent. Ils proposent des analyses de corpus pour identifier le vocabulaire pertinent autour d’une thématique. YourTextGuru fournit ainsi des indicateurs comme le score d’optimisation ou le score de danger, afin de guider la rédaction sans tomber dans la sur-optimisation.

Cette approche est d’autant plus puissante lorsqu’elle est combinée à un maillage interne parfaitement optimisé. Le cocon sémantique cher à Laurent Bourrelly représente une technique très efficace pour structurer l’information et renforcer la cohérence thématique d’un site.

Les réseaux sociaux et la vidéo entrent dans le game

C’est également la période où les nouveaux formats explosent. YouTube, Facebook, puis LinkedIn et Instagram deviennent des canaux majeurs de diffusion de contenu. La vidéo et les publications sociales prennent de l’importance dans la visibilité des marques.

Mais ces univers restent encore largement séparés du SEO on-site. Les équipes marketing travaillent souvent en silos : d’un côté le référencement, de l’autre les réseaux sociaux et la production vidéo.

Pour les marques, l’enjeu va être de raisonner en termes de visibilité organique globale.

2026 : un bon contenu est un système

Les IA sont des outils sémantiques

La façon dont les moteurs comprennent le texte a évolué depuis quelques années. Plutôt que de fonctionner par simple correspondance de mots-clés, ils utilisent des embeddings, des représentations vectorielles du contenu où les concepts proches se regroupent naturellement.

Les modèles d’IA générative à base de Transformers, comme BERT ou GPT, ont renforcé cette logique. Un LLM utilise des tokens. Et surtout, il lit une page sous forme de morceaux de texte pouvant être exploités indépendamment, les chunks. D’où l’importance de formats clairs, digestes et bien balisés : paragraphes courts, listes, tableaux, FAQ.

Du backlink à la mention

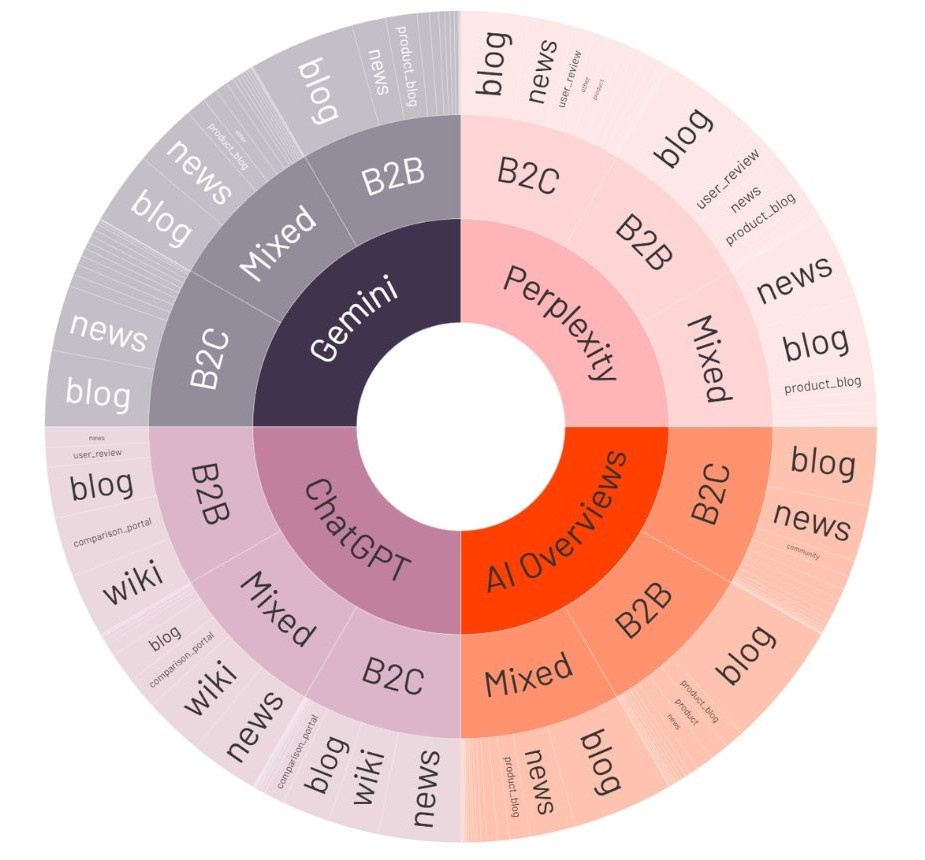

Nous l’avons évoqué, le backlink a été historiquement la principale mesure d’autorité sur le web. Bien qu’elle reste valable, cette logique s’est élargie. Les moteurs et les IA prennent davantage en compte les mentions de marque et les signaux d’autorité globale.

💡 A mon sens, c’est une excellente nouvelle et une très belle opportunité pour le SEO. Parfois considéré comme une compétence technique séparée du reste du marketing, il est replacé au centre des stratégies de marque.

Google a montré la voie avec son concept d’EEAT. Pour ressortir, votre contenu doit démontrer toute votre expertise. Il faut faire la preuve de votre expérience réelle, sur la base d’exemples concrets et de points de vue assumés. Exit les textes génériques, tièdes et interchangeables, produits à la chaîne par les outils d’IA (et c’est tant mieux).

Tout en restant pertinent sémantiquement, apportez du content gain, c’est-à-dire de l’information nouvelle sur le web. Cela peut passer par un angle original, des données propriétaires inédites ou une analyse personnelle. Plus que jamais, raisonnez en cocon vectoriel et structurez vos contenus en ensembles cohérents autour d’un même sujet.

Navboost et les signaux comportementaux

Bien optimisé, votre contenu doit aussi fonctionner auprès des utilisateurs.Google utilise l’algorithme Navboost, révélé au grand public en 2024, pour ajuster les classements en fonction des données de navigation.

Et je peux vous le confirmer, c’est très efficace ! A titre personnel, j’ai eu l’occasion de le constater après avoir enrichi l’article sur la segmentation RFM publié sur le site de DinMo. Les signaux comportementaux (temps passé sur la page, interactions, taux de rebond) sont des facteurs très favorables pour améliorer votre position sur la SERP.

Multimodalité et distribution

Adaptez-vous aussi à l’époque. Un contenu performant ne peut plus se contenter de vivre uniquement sur une page web. Il existe sous plusieurs formes : texte, image, audio, vidéo.

Et surtout, faites-le circuler sur plusieurs plateformes : site web, réseaux sociaux, podcasts, webinars. Le repurposing permet de toucher différents publics tout en renforçant la cohérence de la marque.

Le vrai débat n’est pas IA vs humain

Malgré toutes les évolutions récentes, les fondamentaux du SEO n’ont pas changé. Votre site doit toujours être techniquement irréprochable : contenus accessibles aux moteurs, structure claire, titres et meta descriptions soignés.

Efforcez-vous de répondre rapidement à l’intention de recherche tout en apportant la profondeur nécessaire. Au-delà des backlinks, la cohérence des messages et la crédibilité de la marque jouent un rôle déterminant.

Le trafic IA est qualifié mais encore limité

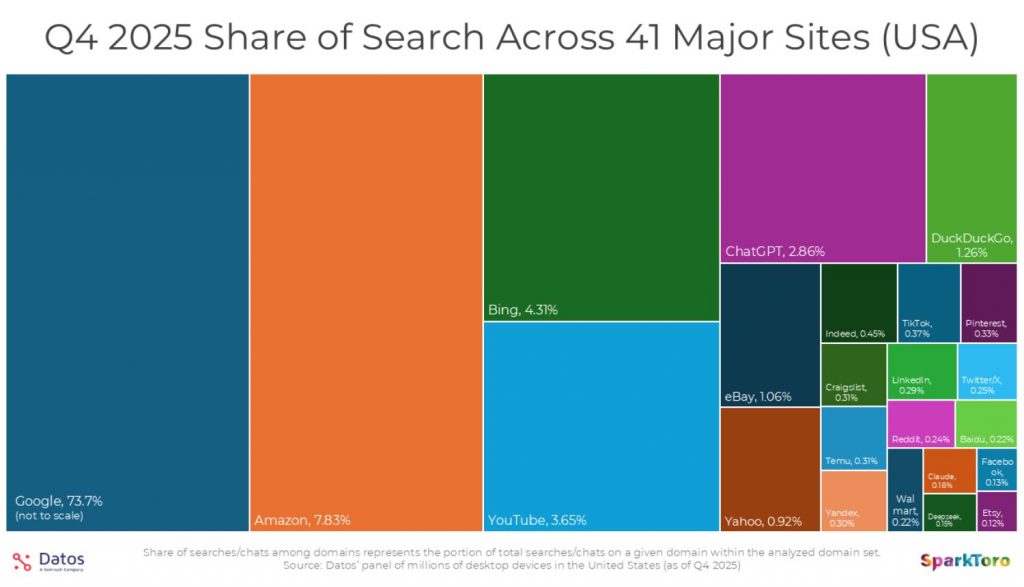

On parle beaucoup de la visibilité dans les LLM ou les AI Overviews comme d’un game changer. Dans les faits, le trafic issu des moteurs génératifs reste encore modeste. La plupart des études (Sparktoro, Semrush, Ahrefs) indiquent un ordre de grandeur compris entre 1 % et 2 % du trafic global aujourd’hui.

Mais cela ne veut pas dire que le phénomène est marginal ! Il s’agit généralement d’un trafic très qualifié et en forte progression. Les utilisateurs qui arrivent via une conversation avec une IA ont généralement déjà passé une première étape de tri dans leur recherche d’information. Le LLM est en quelque sorte perçu comme un influenceur neutre digne de confiance.

Ma conviction profonde est que le GEO ne vient pas remplacer le SEO. C’est une compétence additionnelle à maîtriser. Pour apparaître dans les réponses des moteurs IA, il faut presque toujours commencer par respecter les bonnes pratiques du référencement classique.

Inutile d’opposer humain et IA

L’intelligence artificielle est là, accessible à tous. Il n’y aura pas de retour en arrière. Le débat n’est pas de savoir si vous l’utilisez pour générer votre contenu. Au fond, le vrai problème c’est l’inutilité.

Le web est déjà saturé de contenus moyens, redondants ou génériques. Les moteurs comme les LLM cherchent donc naturellement à privilégier ce qui apporte une réelle valeur : une expérience, un point de vue différencié, des données spécifiques ou une explication originale.

Autrement dit, la question n’est pas “IA ou humain”. La question est : est-ce que ce contenu apporte de la valeur ?

Alors, c’est quoi un bon contenu en 2026 ?

J’ai écrit environ 380 000 mots sur le blog de DinMo depuis novembre 2024. Une centaine d’articles, en français et en anglais. Certains ont performé au-delà de mes espérances, d’autres étaient parfaitement optimisés mais n’ont pas atteint la première page. Loin d’être une science exacte, le SEO peut aussi être terriblement frustrant parfois.

Il y a aussi beaucoup de contenus pour lesquels j’avais une idée précise de la place qu’on allait obtenir dans la SERP avant même de les indexer. Pourquoi ? Un peu grâce à l’expérience, mais avant tout grâce à la cohérence. Chaque publication est organisée et optimisée au service d’un même message : “DinMo est la CDP composable destinée à faciliter la vie des équipes marketing et des équipes data.”

Alors si l’on devait résumer toutes ces évolutions en quelques principes simples, la définition d’un bon contenu n’a finalement rien de révolutionnaire. Sur la partie on-site, c’est d’abord une technique irréprochable : pages crawlables, structure claire, balisage impeccable, formats lisibles pour les moteurs comme pour les IA. Sur Youtube, soignez vos titres, les descriptions, le nom de votre fichier, les transcripts des vidéos.

Il doit bien entendu être solide sémantiquement. Le sujet est traité en profondeur, avec des phrases courtes à la voix active. Pas de suspense inutile : les notions clés sont couvertes dès l’entame, et le support proposé côté parfaitement avec l’intention de recherche.

On est d’accord, mais tout cela ne suffit plus. Pensez “omnimodal” (= omnicanal + multimodal). Chaque support renforce la visibilité organique de la marque. Distribuez votre contenu intelligemment : site web, réseaux sociaux, webinar vidéo, infographies, podcast audio, etc.

Il doit aussi être cité et mentionné. Et surtout, cela va de pair, un bon contenu est engageant et surtout utile. L’autorité ne se construit pas seulement à coups de backlinks, mais avec une présence cohérente sur l’ensemble de l’écosystème numérique.

Car au fond, que ce soit pour Google, pour les LLM ou pour les utilisateurs, la logique reste la même : le meilleur contenu est celui qui aide vraiment quelqu’un.